Einführung in die Fernerkundung

Fernerkundung (engl. remote sensing, franz. télédétection) ist die Bezeichnung für alle Verfahren, die sich mit dem

- Beobachten, Speichern, Kartieren und Interpretieren bzw. Klassifizieren von Erscheinungen auf der Erdoberfläche, einschließlich der Meere, sowie in der Atmosphäre oder auf der Oberfläche und in der Atmosphäre anderer Himmelskörper befassen,

- die ohne direkten physischen Kontakt des abbildenden oder nichtabbildenden Aufnahmesystems, des sogenannten Sensors, mit dem zu erkundenden Objekt arbeiten,

- die das Beobachtungsobjekt i.d.R. über eine Distanz größer einige hundert Meter abbilden (nicht: Nahbereichsphotogrammetrie), und

- die zur Gewinnung von Informationen meist die elektromagnetische Strahlung oder akustische Wellen (SONAR) benutzen, die vom beobachteten Objekt abgestrahlt wird.

Folglich ist die Informationsgewinnung mit Fernerkundungssystemen von In situ-Verfahren zu unterscheiden, welche die Messwerterfassung direkt am Ort der zu messenden Variablen durchführen.

Weitere Definitionen

Eine sehr weit gefasste Definition des Begriffs Fernerkundung liefert Hildebrandt (1996 S. 1): ,,Fernerkundung im umfassenden Sinne ist die Aufnahme oder Messung von Objekten, ohne mit diesen in körperlichen Kontakt zu treten, und die Auswertung dabei gewonnener Daten oder Bilder zur Gewinnung quantitativer oder qualitativer Informationen über deren Vorkommen, Zustand oder Zustandsänderung und ggf. deren natürliche oder soziale Beziehungen zueinander." Diese sehr breite Begriffsbildung schließt auch analoge Verfahren wie die Erstellung von analogen Luftbildern, d.h. das Photographieren mit einer Kamera auf Film, sowie auch die Messung der Strahlungstemperatur durch flugzeuggestützte Messgeräte oder sogar per Hand ein. Sämtliche Verfahren erfassen elektromagnetische Strahlung wie das sichtbare Licht, Wärmestrahlung und andere nicht sichtbare Strahlung, die von den Untersuchungsobjekten auf der Erde (z.B. Grünflächen) oder in der Atmosphäre (z.B. Wolken) emittiert oder reflektiert werden, wobei die Objekte je nach Art oder Beschaffenheit (z.B. Vegetation) und Zustand (z.B. geschädigter Waldbestand oder abgeerntete Getreidefelder) auf unterschiedliche Weise emittieren oder reflektieren.

Teilweise werden die Arbeitsschritte Auswertung und Interpretation nicht zur Fernerkundung (FE) im engeren Sinne gerechnet. Auch wird häufig die Aufzeichnung von Gravitationsfeldern, magnetischen oder elektrischen Feldern sowie von akustischen Wellen (Sonar) nicht dem Begriff FE zugeordnet.

Begriffshistorisch ist Fernerkundung ein sehr junges Arbeitsfeld. Seit der erstmaligen Aufnahme von Luftbildern stand die Ausmessung der aufgenommenen Objekte im Vordergrund (Photogrammetrie). Die Verwendung des Begriffs "remote sensing" begann in den frühen 1960er Jahren, als die Geographin Evelyn Pruitt erkannte, dass die Luftbildfotographie aufgrund des wissenschaftlichen Fortschritts nicht mehr geeignet war, um die durch neue Technologien erzeugten Datenströme zu beschreiben. Mit Unterstützung ihres Mitarbeiters im Office of Naval Research, Walter Bailey, prägte sie den Begriff "Remote Sensing". Im deutschen Sprachraum entwickelte sich der Begriff Fernerkundung erst Anfang der 70-er Jahre als Übersetzung des vonden amerikanischen Wissenschaftlern geprägten Ausdrucks „Remote Sensing“.

DIN 18716 (Photogrammetrie und Fernerkundung – Begriffe) vom Juni 2017 definiert Fernerkundung (FE) wie folgt: "Gesamtheit der Verfahren zur Gewinnung von Informationen von entfernten Objekten ohne direkten Kontakt mit diesen durch Messung und Interpretation von reflektierter und emittierter elektromagnetischer Strahlung".

Dieser Definition von Fernerkundung und zugehöriger Begriffe bei DIN wird der diesbezügliche Anwendungsbereich vorangestellt:

"Diese Norm legt die Begriffe der Fernerkundung der Erde einschließlich darauf befindlicher Objekte mit abbildenden digitalen Sensorsystemen von Standorten auf der Erde, von Luftfahrzeugen (insbesondere Flugzeugen) oder Satelliten fest. Sie dient der Vereinheitlichung der Grundbegriffe und Benennungen.

Anwendung findet die Fernerkundung zur Erfassung und Beobachtung der Erdoberfläche im weitesten Sinne, insbesondere zur Kartierung und Überwachung der Geo- und Biosphäre, zur Datengewinnung im Geoinformationswesen, Erstellung von Planungsunterlagen und zur Beobachtung natürlicher und anthropogener Veränderungen von Ökosystemen. Darunter fallen auch Anwendungen in Vermessungswesen und Kartographie, darüber hinaus aber in einem breiten Spektrum weiterer Fachgebiete wie Raumordnung und Landesplanung, Forstwirtschaft, Bauingenieurwesen, Architektur, Denkmalschutz und Archäologie, Industriemessung, Unfallaufnahme und Kriminalistik, Medizin und andere.

Die Aussagen gelten sinngemäß auch für die Erkundung extraterrestrischer Körper.

In der Ozeanographie und in der Meteorologie wurden eigene Fernerkundungsverfahren entwickelt. Die damit zusammenhängenden Begriffe sind nicht Gegenstand dieser Norm.

Diese Norm bezieht sich auf die Detektion und Auswertung elektromagnetischer Strahlung und nicht auf Magnet- und Schwerefelder."

Die Fernerkundung bietet die Möglichkeit, große Gebiete in hoher zeitlicher und räumlicher Auflösung zu erfassen. Vorteile (s. u.) gegenüber anderen Verfahren liegen vor allem in der automationsgestützten Auswertung, in der Nutzung von homogenen Daten, der einheitlichen Auswertung und der Kombinationsmöglichkeit verschiedener Daten und Verfahren.

Untergliederung von Fernerkundungssystemen

Fernerkundungssysteme können untergliedert werden in ein Sensorsegment, in ein Bodensegment und in ein Veredlungssegment.

- Ein Sensorsegment besteht allgemein aus der Plattform und dem eigentlichen Sensor. Zumeist wird auf einer Drohne (UAS), auf einem Flugzeug oder auf einem Satelliten ein digitaler Multispektralabtaster (Scanner) geführt, der in verschiedenen Bereichen des elektromagnetischen Spektrums die eintreffende Strahlung erfasst.

Fernerkundungssensoren sammeln Daten, indem sie die von der Erde reflektierte bzw. abgestrahlte Energie erfassen.

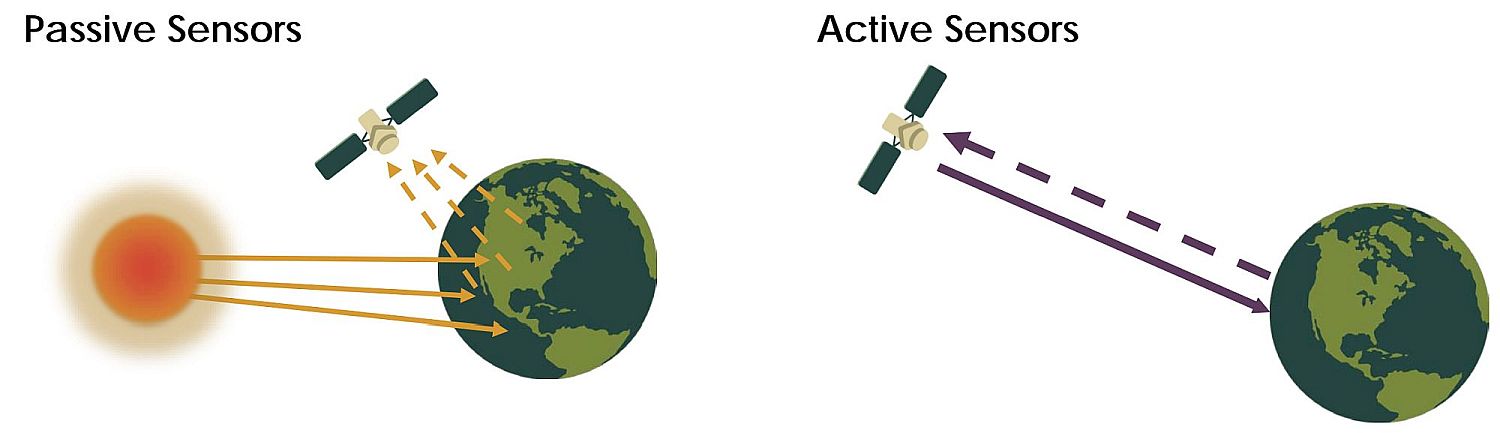

Diese Sensoren können entweder passiv oder aktiv sein (s.u.). Passive Sensoren reagieren auf äußere Reize. Sie erfassen natürliche Energie, die von der Erdoberfläche reflektiert oder ausgestrahlt wird. Die häufigste Strahlungsquelle, die von passiven Sensoren erfasst wird, ist reflektiertes Sonnenlicht.

Im Gegensatz dazu nutzen aktive Sensoren interne Reize, um Daten über die Erde zu sammeln. Ein Laser-Fernerkundungssystem beispielsweise projiziert einen Laser auf die Erdoberfläche und misst die Zeit, die der Laser braucht, um zum Sensor zurück zu reflektieren.

Die Aufgaben eines digitalen, satellitengestützten Sensorsegments sind somit die Abtastung eines Gebietes (Scannen) sowie u.a. die Digitalisierung und Kodierung der Daten und die Zwischenspeicherung mit anschließender Übertragung zur Bodenstation.

- Die Aufgabe des Bodensegments besteht im Empfang und der Aufzeichnung (nur bei Satelliten) sowie der Aufbereitung und der Vorverarbeitung der Daten. Dabei gehören zur Aufbereitung u.a. Systemkorrekturen, das Hinzufügen von Zusatzinformationen (u.a. Aufnahmezeit) sowie geometrische oder radiometrische Korrekturen. Als Ergebnis entstehen sogenannte systemkorrigierte Daten.

- Im Veredlungssegment wird die eigentliche Umsetzung der erfassten Daten in interpretierbare Ausgabebilder vorgenommen, wodurch die Auswertung und Nutzung von Fernerkundungsdaten erfolgt. Hierzu werden Methoden der visuellen Interpretation und der digitalen Bildverarbeitung herangezogen.

Fernerkundungsplattformen

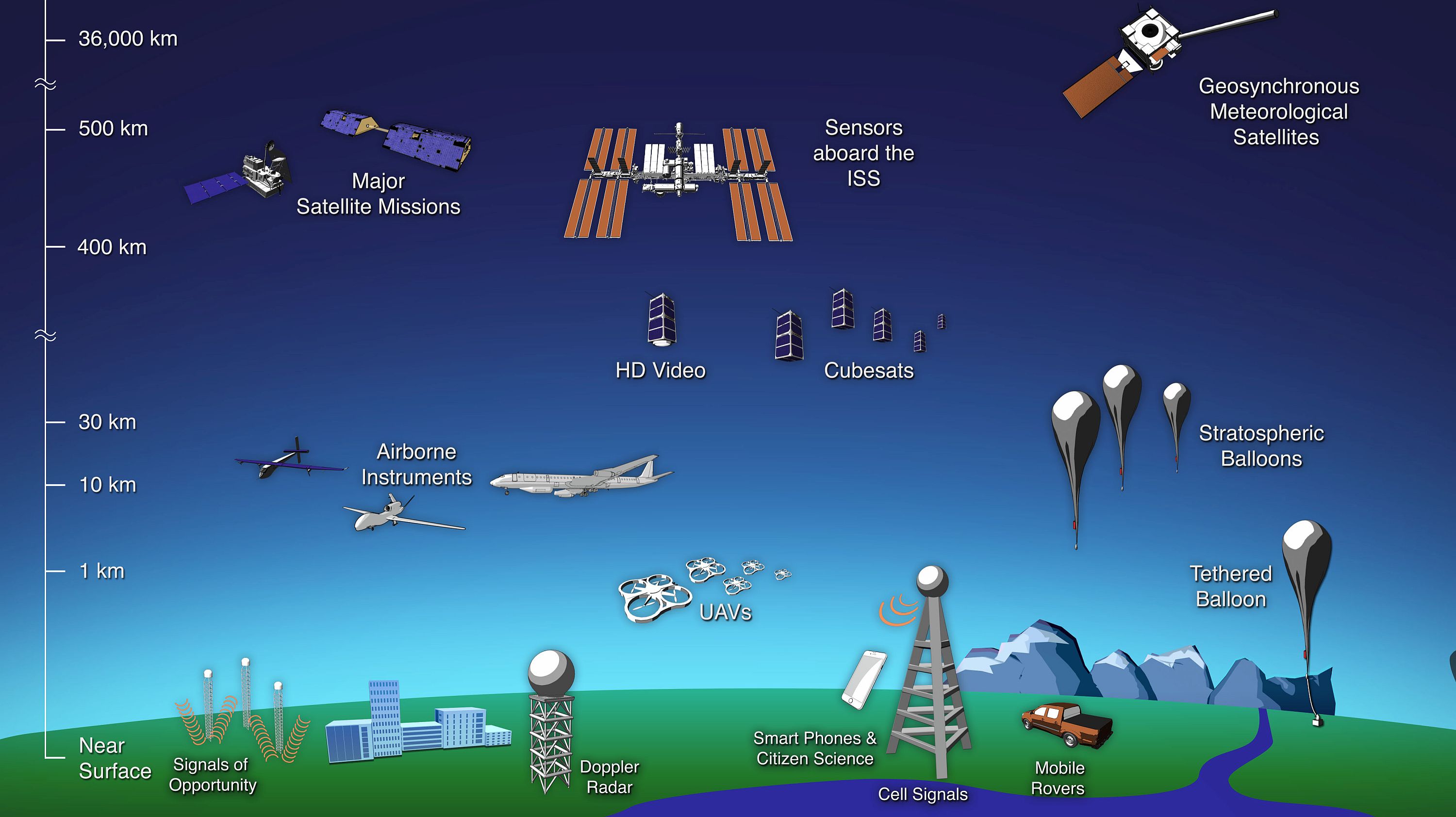

Fernerkundungsplattformen sind Tragestrukturen, die mit Instrumenten (Sensoren) ausgestattet sind, um Daten aus der Ferne sammeln zu können.

Man unterscheidet in der Fernerkundung drei Haupttypen von Plattformen:

- bodengestützte (Stative und Türme),

- luftgestützte (bemannte Flugzeuge und unbemannte Luftfahrzeuge) und

- satellitengestützte Plattformen, die die Datenerfassung von der Erdoberfläche, der Atmosphäre und den Ozeanen ermöglichen.

Jede Plattform hat ihre eigenen Fähigkeiten und Eigenschaften, die sie für bestimmte Anwendungen geeignet machen.

Bodenplattformen werden für die Erfassung von Daten aus nächster Nähe zur Erdoberfläche verwendet, luftgestützte Plattformen sind ideal für die Erfassung hochaufgelöster Bilder und Daten über kleine Gebiete, und Weltraumplattformen werden für die Erfassung von Daten aus globaler Perspektive eingesetzt.

Das folgende Diagramm zeigt die Vielfalt der heute verwendeten Fernerkundungsplattformen, die einen Blick auf unseren Planeten in verschiedenen Maßstäben und Auflösungen ermöglichen.

Remote Sensing Platforms  Quelle: NASA SVS Quelle: NASA SVS |

Bodensegment

Ein Bodensegment besteht aus allen bodengestützten Elementen eines Raumfahrtsystems, die von Betreibern und Hilfspersonal genutzt werden, im Gegensatz zum Raumsegment und Nutzersegment. Das Bodensegment ermöglicht das Management eines Raumfahrzeugs und die Verteilung von Nutzlastdaten und Telemetriedaten an interessierte Gruppen am Boden. Die wichtigsten Elemente eines Bodensegments sind:

- Bodenstationen (oder Erdstationen), die Funkschnittstellen zu Raumfahrzeugen bereitstellen

- Missionskontrollzentren (oder Betriebszentren), von denen aus die Raumfahrzeuge gesteuert werden

- Fernterminals, die vom Hilfspersonal genutzt werden

- Integrations- und Testeinrichtungen für Raumfahrzeuge

- Startanlagen

- Bodenfunknetze, die die Kommunikation zwischen den anderen Bodenelementen ermöglichen

Diese Elemente sind bei fast allen Raumfahrtmissionen vorhanden, unabhängig davon, ob es sich um kommerzielle, militärische oder wissenschaftliche Missionen handelt. Sie können zusammen gruppiert oder geographisch getrennt sein und von verschiedenen Parteien betrieben werden. Einige Elemente können mehrere Raumfahrzeuge gleichzeitig unterstützen.

DLR Earth Observation Centre - Nationales Bodensegment Neustrelitz

Mit einem Durchmesser von 11,5 m und einer Fläche von 103 m² verfügt die neue Tri-Band-Antenne über einen mehr als doppelt so großen Empfangsspiegel als die bisherigen Systeme. Quelle: DLR |

Veredlungssegment

Im Veredlungssegment wird die eigentliche Umsetzung der erfassten Daten in interpretierbare Ausgabebilder vorgenommen, wodurch die Auswertung und Nutzung von Fernerkundungsdaten erfolgt. Hierzu werden Methoden der visuellen Interpretation und der digitalen Bildverarbeitung herangezogen.

Die erfolgreiche Interpretation von Luft- und Satellitenbildern setzt voraus, dass der Bearbeiter die notwendige Sachkenntnisse hinsichtlich des Gegenstandes der Interpretation mitbringt. Dies kann die Anwendungsdisziplin betreffen (z.B. forstwirtschaftliche Kenntnisse für die forstliche Luftbildinterpretation) oder auch die Region (z.B. landeskundliche Kenntnisse zur Interpretation von Bildern aus einem Entwicklungsland). Auch ist in gewissem räumlichen Umfang eine detaillierte Verifikation wesentlich für den effektiven Einsatz von FE. Darüber hinaus sind Kenntnisse über die Entstehung der Bilder und ihre Eigenschaften erforderlich, um die durch die Interpretation gegebenen Möglichkeiten der Informationsgewinnung voll ausschöpfen zu können und Fehlinterpretationen nach Möglichkeit zu vermeiden.

Die Nutzer von Fernerkundungsinformationen lassen sich grob in zwei Gruppen unterteilen: Es gibt einerseits die wissenschaftlichen Nutzer an Universitäten und Forschungszentren, die sich mit der Erforschung und Weiterentwicklung der Auswertetechniken und der Erschließung neuer Anwendungen befassen. Sie verwenden bevorzugt die Rohdaten bzw. die systemkorrigierten Daten. Die zweite Gruppe setzt sich aus behördlichen und industriellen Nutzern zusammen, die für die jeweilige praktische Anwendung vorverarbeitete Daten benötigen, bei denen die Bilder z.B. radiometrisch kalibriert und auf eine Kartenprojektion entzerrt wurden.

Zur Auswertung von Fernerkundungsdaten ist ein Standard-PC oft vollkommen ausreichend. Da die Bilddaten in Rasterform vorliegen ist mehr Speicher von Vorteil. Bei der Verarbeitung von Satellitenbildern ist das vorrangige Ziel nicht die Verbesserung des Erscheinungsbildes, sondern die Extraktion inhaltlicher Information. Handelsübliche Bildbearbeitungsprogramme sind nur in begrenztem Umfang für diesen Zweck einsetzbar. Daher ist eine Bildauswerte-Software erforderlich, die es sowohl erlaubt, Bilder unterschiedlicher Formate in beliebiger Kanalkombination einzulesen, die aber auch Module zur radiometrischen Veränderung (z.B. Kontrastoptimierung), Filterung (Hochpass-, Tiefpassfilter), Bildarithmetik (Subtraktion, Maskierung) und Klassifizierung (Clustering) enthält. Solche Software wird als abgespeckte Public Domain bzw. Shareware (MultiSpec, ENVI-FreeLook), kostenlose oder preiswerte Schul-Software (LEOWorks, IDRISI /TerrSet) und professionelle Programm-Pakete (ERDAS IMAGINE, ArcGIS, Trimble eCognition) angeboten.

Mit Hilfe von Bildklassifizierungsalgorithmen können verschiedene Bodenbedeckungstypen leichter unterschieden werden. Bei der Bildklassifizierung werden die spektralen Informationen der einzelnen Bildpixel verwendet. Karten oder Bilder können auch in ein geographisches Informationssystem (GIS) integriert werden, und dann kann jedes Pixel mit anderen GIS-Daten, wie etwa Volkszählungsdaten, verglichen werden.

Weitere Informationen über die Integration geowissenschaftlicher Daten der NASA in ein GIS finden Sie auf der Seite Earthdata GIS. Für das freie QGIS gibt es Tutorials z.B. zur Verarbeitung der europäischen Sentinel-Daten.

Funktionsweise von Fernerkundung in Kürze

Zunächst ist zu unterscheiden zwischen Passiven Fernerkundungsverfahren oder -systemen und Aktiven Fernerkundungsverfahren oder -systemen. Erstere zeichnen elektromagnetische Strahlung auf, die von der Erdoberfläche reflektiert und/oder emittiert wird. Deren punktbezogenen Messwerte liefern Rasterdaten des aufgenommenen Geländes. Aktive Verfahren wie Radar oder Laser senden kohärente Strahlungsimpulse aus und registrieren die Laufzeit bzw. die Amplituden- und Phasendifferenz der von der Erdoberfläche rückgestreuten Signale.

Technische FE-Verfahren gehen von der Tatsache aus, dass die natürliche oder künstliche Strahlung (z.B. Sonnenlicht, Radar, Schall) von den Objekten unterschiedlich emittiert bzw. reflektiert wird. Das heißt, Grundlage der Fernerkundung ist das objekt- und materialspezifische Reflexionsverhalten. Objektbeschreibende elektromagnetische Strahlung setzt sich in Funktion der Wellenlänge aus spezifischen Anteilen reflektierter, gestreuter und/oder emittierter Strahlung (Reflexion, Streuung, Emission) zusammen. Interaktionsmedien sind die Atmosphäre und die Erdoberfläche im Sinne aller natürlichen und künstlichen Oberflächen. Daher wird ein zentraler Bereich der Fernerkundung auch als Erdbeobachtung (engl. earth observation, EO) bezeichnet.

|

Schema eines passiven Sensors im Vergleich zu einem aktiven Sensor Passive Sensoren messen die Temperatur der Land- und Meeresoberfläche, die Eigenschaften der Vegetation, die Eigenschaften von Wolken und Aerosolen und andere physikalische Eigenschaften. Die meisten passiven Sensoren können eine dichte Wolkendecke nicht durchdringen. Aktive Sensoren eignen sich u.a. zur Messung der vertikalen Profile von Aerosolen, der Waldstruktur, des Niederschlags und der Winde, der Topographie der Meeresoberfläche und des Eises. Quelle: NASA |

Passive Verfahren

Abgesehen von technischen Lösungen ist das menschliche Sehvermögen bereits ein eindrucksvolles Fernerkundungssystem. Unsere Augen nehmen das von unserer Umgebung reflektierte sichtbare Licht (Spektralbereich 0,4-0,7 Mikrometer) auf, das dann vom Gehirn als Bild verstanden wird. Mental interpretieren wir die Farben, Strukturen, Umrisse und Größen von Objekten um daraus Informationen wie ihre Identität, ihr Zustand, ihre Geschwindigkeit und Bewegungsrichtung und andere Qualitäten abzuleiten. Allerdings hat unser Sehsystem Begrenzungen im Hinblick auf globale Erkundungsaufgaben. Unser Vermögen, Bilder zu speichern und wieder abzurufen, ist ungenau. Zudem können wir keine Informationen aufnehmen, die Wellenlängen benutzen, für die unser Auge nicht wahrnehmbar sind. Auch verschließen sich dem menschlichen Beobachter Gebiete die schwer zu erreichen oder gefährlich sind wie die Tiefsee, das Weltall und Gebiete mit hohen Temperaturen oder starker Strahlung. Flugzeug- und satellitengetragene Sensoren liefern eine Vielfalt von Umweltdaten von Flächen, die mit anderen Mitteln nicht zusammengetragen werden können.

Aktive Verfahren

Passive Systeme können nur von Objekten reflektierte oder emittierte Strahlung aufzeichnen (z.B. das Multi-Spectral Instrument an Bord der Sentinel-2). Demgegenüber senden aktive Fernerkundungsverfahren wie Radar (z.B. das C-Band Synthetic Aperture Radar an Bord von Sentinel-1 ) oder Laser (LIDAR) kohärente Strahlungspulse aus und registrieren die Laufzeit bzw. die Amplituden- und Phasendifferenz der von der Erdoberfläche rückgestreuten/reflektierten Signale. Radiometrische Korrekturen berücksichtigen die Strahlungscharakteristika der jeweiligen Energiequellen.

| Aufnahme- plattform |

Satellit/Raumfähre | Flugzeug/Ballon | Stationär | |||||||

|---|---|---|---|---|---|---|---|---|---|---|

| Aufnahme- modus |

passiv (elektrooptisch, thermales Infrarot, thermale Mikrowelle) |

aktiv (Laser, Radar) |

||||||||

| Aufnahme- medium |

analog (Kamera, Video) |

digital (Whiskbroom, Line Array, 2D CCD) |

||||||||

| Spektral- bereich |

sichtbar/ultraviolett | reflektiertes Infrarot | thermales Infrarot | Mikrowelle | ||||||

| Spektrale Auflösung |

panchromatisch 1 Band |

multispektral 2-20 Bänder |

hyperspektral 20-250 Bänder |

ultraspektral >250 Bänder |

||||||

| Radiometrische Auflösung |

sehr hoch (>12 Bit) |

hoch (8-12 Bit) |

mittel (6-8 Bit) |

niedrig <6 Bit) |

||||||

| Räumliche Auflösung |

ultrahoch <1m |

sehr hoch 1-4 m |

hoch 4-10 m |

mittel 10-50 m |

niedrig 50-250 m |

sehr niedrig >250 m |

||||

| übersetzt nach Ehlers, Janowsky & Gähler (2001): New Remote Sensing Concepts for Environmental Monitoring, Proceedings, SPIE Conference on Remote Sensing for Environmental Monitoring, GIS Applications and Geology, Toulouse | ||||||||||

Beobachten mit Hilfe des elektromagnetischen Spektrums

Elektromagnetische Energie, die durch die Schwingung geladener Teilchen erzeugt wird, breitet sich in Form von Wellen durch die Atmosphäre und das Vakuum des Weltraums aus. Diese Wellen haben unterschiedliche Wellenlängen (der Abstand von Wellenberg zu Wellenberg) und Frequenzen; eine kürzere Wellenlänge bedeutet eine höhere Frequenz. Einige, wie Radio-, Mikrowellen- und Infrarotwellen, haben eine längere Wellenlänge, während andere, wie Ultraviolett-, Röntgen- und Gammastrahlen, eine viel kürzere Wellenlänge haben. Das sichtbare Licht liegt in der Mitte dieses Bereichs zwischen lang- und kurzwelliger Strahlung. Dieser kleine Teil der Energie ist alles, was das menschliche Auge wahrnehmen kann. Um alle anderen Formen der elektromagnetischen Energie zu erkennen, sind Instrumente erforderlich. Die Instrumente beispielsweise der NASA nutzen die gesamte Bandbreite des Spektrums, um Prozesse auf der Erde und auf anderen Planeten zu erforschen und zu verstehen.

Dieses Grundprinzip beruht darauf, dass die Objekte ein für sie charakteristisches Strahlungs- oder Reflexionsverhalten besitzen. Eine Wasseroberfläche reflektiert z. B. die eintreffende Infrarotstrahlung im Wellenlängenbereich zwischen 0,7 und 0,9 µm völlig anders als eine trockene Savannenfläche. Das spezifische Strahlungs- oder Reflexionsverhalten unterschiedlicher Objekte ermöglicht letztlich ihre Identifikation. Anhand der durch die Fernerkundung erfassten elektromagnetischen Strahlung kann auf die Objekte rückgeschlossen werden. Diese stark vereinfachte Darstellung berücksichtigt nicht die Einflüsse der Atmosphäre.

| Diagramm des elektromagnetischen Spektrums |

Einige Wellen werden von atmosphärischen Bestandteilen wie Wasserdampf und Kohlendioxid absorbiert oder reflektiert, während sich andere Wellenlängen ungehindert durch die Atmosphäre bewegen können; sichtbares Licht hat Wellenlängen, die durch die Atmosphäre übertragen werden können. Mikrowellenenergie hat Wellenlängen, die Wolken durchdringen können, eine Eigenschaft, die von vielen Wetter- und Kommunikationssatelliten genutzt wird.

Die Hauptquelle der von den Satelliten beobachteten Energie ist die Sonne. Die Menge der reflektierten Sonnenenergie hängt von der Rauheit der Oberfläche und ihrer Albedo ab, d. h. davon, wie gut eine Oberfläche Licht reflektiert, anstatt es zu absorbieren. Schnee zum Beispiel hat eine sehr hohe Albedo und reflektiert bis zu 90 % der einfallenden Sonnenstrahlung. Der Ozean hingegen reflektiert nur etwa 6 % der einfallenden Sonnenstrahlung und absorbiert den Rest. Wenn Energie absorbiert wird, wird sie oft wieder emittiert, meist bei längeren Wellenlängen. Die vom Ozean absorbierte Energie wird zum Beispiel als Infrarotstrahlung wieder abgestrahlt.

Alle Dinge auf der Erde reflektieren, absorbieren oder übertragen Energie, wobei die Menge je nach Wellenlänge variiert. So wie Ihr Fingerabdruck einzigartig ist, hat alles auf der Erde einen einzigartigen spektralen Fingerabdruck (spektrale Signatur). Forscher können diese Informationen nutzen, um verschiedene Erdmerkmale sowie verschiedene Gesteins- und Mineralienarten zu identifizieren. Die Anzahl der von einem bestimmten Instrument erfassten Spektralbänder, d. h. die spektrale Auflösung, bestimmt, inwieweit ein Forscher zwischen verschiedenen Materialien unterscheiden kann.

Weitere Informationen über das elektromagnetische Spektrum mit begleitenden Videos finden Sie auf der NASA-Seite Tour of the Electromagnetic Spectrum.

Auflösung

Die Auflösung spielt eine Rolle dabei, wie die Daten eines Sensors genutzt werden können. Die Auflösung kann je nach Satellitenumlaufbahn und Sensordesign variieren. Es gibt vier Arten von Auflösungen, die für jeden Datensatz zu berücksichtigen sind: radiometrische, räumliche, spektrale und zeitliche.

Die radiometrische Auflösung ist die Menge an Informationen in jedem Pixel, d. h. die Anzahl der Bits, die die aufgezeichnete Energie darstellen. Jedes Bit erfasst einen Exponenten der Potenz 2. Eine 8-Bit-Auflösung beträgt beispielsweise 28, was bedeutet, dass der Sensor 256 potenzielle digitale Werte (0-255) zur Speicherung von Informationen hat. Je höher die radiometrische Auflösung ist, desto mehr Werte stehen für die Speicherung von Informationen zur Verfügung, so dass selbst kleinste Energieunterschiede besser unterschieden werden können. Bei der Bewertung der Wasserqualität beispielsweise ist die radiometrische Auflösung notwendig, um feine Unterschiede in der Farbe des Meeres zu erkennen.

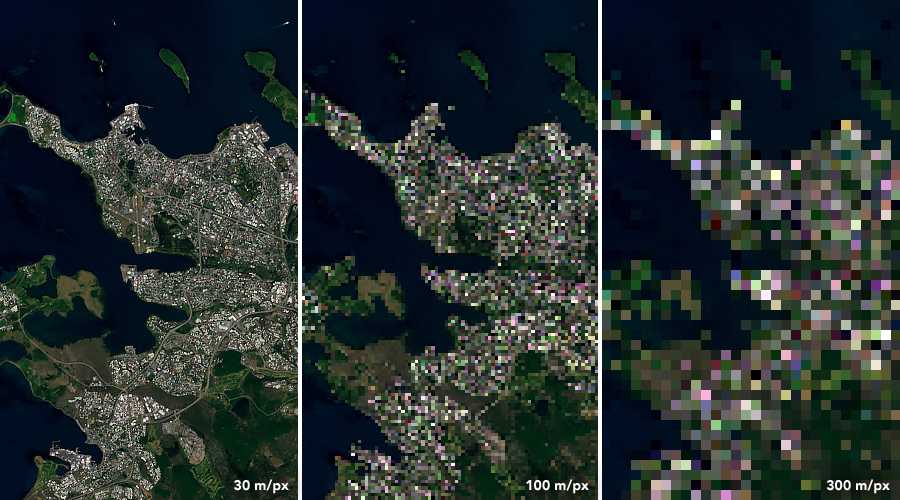

Die räumliche Auflösung wird gewöhnlich durch die Größe jedes Pixels in einem digitalen Bild und die Fläche auf der Erdoberfläche definiert, die durch dieses Pixel dargestellt wird.

|

Welche räumliche Auflösung wird gebraucht? Für bestimmte Beobachtungs- oder Forschungszwecke können unterschiedliche räumliche Auflösungen verwendet werden. Diese Abbildung zeigt Beispiele für die räumliche Auflösung gängiger NASA-Sensorprodukte und einen Forschungsmaßstab, für den sie geeignet sind (regional, national, kontinental usw.). Quelle:NASA Earthdata |

Die meisten der vom Moderate Resolution Imaging Spectroradiometer (MODIS) beobachteten Bänder haben beispielsweise eine räumliche Auflösung von 1 km; jedes Pixel repräsentiert einen Bereich von 1 km x 1 km auf dem Boden. MODIS umfasst auch Bänder mit einer räumlichen Auflösung von 250 m oder 500 m. Je feiner die Auflösung (je niedriger die Zahl), desto mehr Details können Sie sehen. In der folgenden Abbildung sehen Sie den Unterschied in der Pixelung zwischen einem 30-Meter-Pixel-Bild (linkes Bild), einem 100-Meter-Pixel-Bild (mittleres Bild) und einem 300-Meter-Pixel-Bild (rechtes Bild).

|

Reykjavik mit unterschiedlichen räumlichen Auflösungen Landsat 8-Bild von Reykjavik, Island, aufgenommen am 7. Juli 2019, das den Unterschied in der Pixelauflösung verdeutlicht. Quelle: NASA Earthdata |

Die spektrale Auflösung ist die Fähigkeit eines Sensors, feinere Wellenlängen zu erkennen, d. h. mehr und schmalere Bänder zu haben. Viele Sensoren gelten als multispektral, d. h. sie haben 3-10 Bänder. Einige Sensoren haben Hunderte oder sogar Tausende von Bändern und werden als hyperspektral bezeichnet. Je schmaler der Wellenlängenbereich für ein bestimmtes Band ist, desto feiner ist die spektrale Auflösung. Das Airborne Visible/Infrared Imaging Spectrometer (AVIRIS) zum Beispiel erfasst Informationen in 224 Spektralkanälen. Der Würfel auf der rechten Seite zeigt die Detailgenauigkeit der Daten. Auf dieser Detailstufe kann zwischen Gesteins- und Mineralienarten, Vegetationstypen und anderen Merkmalen unterschieden werden. Der kleine Bereich mit hoher Empfindlichkeit in der rechten Ecke des Bildes liegt im roten Bereich des sichtbaren Spektrums (ca. 700 Nanometer) und ist auf das Vorhandensein von 1 Zentimeter langen roten Solegarnelen im Verdunstungsteich zurückzuführen.

|

Datenwürfel mit AVIRIS-Daten Der obere Teil des Würfels ist ein Falschfarbenbild, das gemacht wurde, um die Struktur des Wassers und der Verdunstungsteiche auf der rechten Seite hervorzuheben. Die Seiten des Würfels sind Schnitte, die die Kanten der Oberseite in allen 224 Spektralkanälen von AVIRIS zeigen. Die Oberseiten der Seiten liegen im sichtbaren Bereich des Spektrums (Wellenlänge 400 Nanometer), die Unterseiten im Infrarotbereich (2.500 Nanometer). Quelle: NASA Earthdata |

Die zeitliche Auflösung ist die Zeit, die ein Satellit benötigt, um eine Umlaufbahn zu vollenden und dasselbe Beobachtungsgebiet zu überfliegen. Diese Auflösung hängt von der Umlaufbahn, den Eigenschaften des Sensors und der Breite des Spektrums ab. Da geostationäre Satelliten der Rotationsgeschwindigkeit der Erde entsprechen, ist die zeitliche Auflösung viel feiner. Bei Satelliten in einer polaren Umlaufbahn kann die zeitliche Auflösung zwischen 1 Tag und 16 Tagen liegen. Der MODIS-Sensor an Bord der NASA-Satelliten Terra und Aqua hat beispielsweise eine zeitliche Auflösung von 1 bis 2 Tagen, so dass der Sensor die täglichen Veränderungen der Erde sichtbar machen kann. Der Operational Land Imager (OLI) an Bord des gemeinsamen NASA/USGS-Satelliten Landsat 8 hingegen hat eine geringere Schwadbreite und eine zeitliche Auflösung von 16 Tagen; er zeigt nicht tägliche, sondern zweimonatliche Veränderungen an.

Produkte der Fernerkundung

Produkte der Fernerkundung der Erde sind (geocodierte) originäre oder klassifizierte Bilddaten in digitaler und/oder analoger Form (Orthobild), meist als kombinierte Bild-Strich-Karten (Bildkarte) mit Koordinatenbezug, des weiteren flächenbezogene Statistiken in Tabellen- oder Diagrammform sowie objektspezifische spektrale Signaturenkataloge.

Fernerkundungsdaten liegen zumeist in digitaler Form vor oder können z.B. durch Scannen von Photos digitalisiert werden. Zudem sind sie häufig in Formaten erhältlich, die sie für geographische Informationssysteme (GIS) verwendbar machen. Wichtigste Schritte der Bildanalyse in der Fernerkundung sind Bildverbesserung, geometrische Rektifizierung der perspektiv und projektiv verzerrten Bilder (Geocodierung), Klassifizierung nach multispektralen, textur- und musterabhängigen Parametern, Einbeziehung von Expertenwissen und multitemporale Vergleiche.

Unter den Verfahren der FE sind jene besonders wichtig und am weitesten verbreitet, die zu einer bildhaften Wiedergabe der Erdoberfläche führen (abbildende FE-Systeme).

Unterschieden werden photographische (Luftbilder, früher auch von Satelliten oder aus der ISS und ehemals auch aus dem Space Shuttle) und nicht-photographische Aufnahmeverfahren (digitale Bilder, Radaraufnahmen), die von bemannten Flugzeugen, unbemannten Flugobjekten (Drohnen), bemannten Raumfahrzeugen und Satelliten (Satellitenfernerkundung) oder auch von höher gelegenen Geländepunkten aus zur Erkundung der Erdoberfläche und der Atmosphäre genutzt werden.

Vorzüge der Fernerkundung

Gegenüber der subjektiven Sicht des Menschen besitzt die FE-Technologie einige wichtige Vorteile. Sie verbindet eine synoptische Sichtweise (Großräumigkeit, Gleichzeitigkeit) aus der Vogelperspektive mit raschem Zugriff und kurzen Wiederholraten, Chancen, die eine Bodenbegehung nicht ermöglicht. Dies erlaubt die Analyse und Beobachtung von regionalen und globalen Phänomen, z.B. die Abnahme der Ozonschicht über der Antarktis, Daten zu Wolkentemperatur und Niederschlag, Waldbrände, die Vernichtung des tropischen Regenwaldes, Desertifikationsentwicklung, Landnutzung, Erntezustand, Bewegungen von Gletschereis und Eisbergen, Meeresoberflächentemperaturen oder Sediment- und Chlorophyllkonzentrationen von oberflächennahen Wasserschichten sind nur einige Beispiele.

Fernerkundung ist heute unverzichtbarer Bestandteil von Ressourcen-Kartierungen und Bestandsaufnahmen. Fernerkundungsbilder bieten einen Überblick über die Ressourcen unserer Erde in ihren Zusammenhängen. Vegetation, Geologie, Böden, Hydrologie, Verkehrsnetz und Siedlungsmuster werden alle in ihrem räumlichen Kontext wiedergegeben. Zudem können einzelne FE-Bilder für unterschiedliche Disziplinen und Aufgabenstellungen ausgewertet werden. Wettersatelliten liefern aktuelle Bilder im Stundentakt oder noch häufiger.

Abhängig vom jeweiligen Satellitensystem bilden Erdbeobachtungssatelliten den Globus in eintägigem oder mehrwöchigen Rhythmus ab. Die Daten werden gespeichert, so dass wiederholte Aufzeichnungen des gleichen Objekts verglichen werden können und somit eine kostengünstige Möglichkeit zum Monitoring von zeitabhängigen Veränderungen besteht.

Beispielsweise kann die Entwicklung von Feldfrüchten zu unregelmäßigen Abständen während der Wachstumsperiode durchgeführt werden, um Problemflächen auszumachen und um Erntevorhersagen zu treffen. Die EU setzt FE im Rahmen ihrer Gemeinsamen Agrarpolitik zur Subventionskontrolle ein.

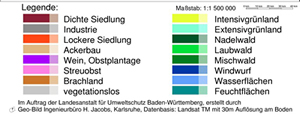

|

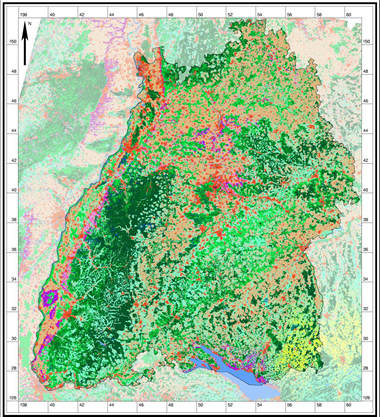

Beispiel für eine Landnutzungserhebung aus Baden-Württemberg mit Landsat-TM-Aufnahmen aus den Jahren 1999 und 2000

|

Einsatzmöglichkeiten von Fernerkundung

Die Fernerkundung kann für eine Vielzahl von Fragestellungen und Interessengebieten eingesetzt werden. Eine Auswahl:

- Kartographie: als Grundlage von topographischen Karten und Landnutzungskarten in wenig durchforschten Gebieten, mittlere bis kleine Maßstäbe

- Kartierung der Bodenbedeckung/Bodennutzung

- Stereophotogrammetrik: Erstellung von digitalen Höhenmodellen sowie, bei höchstauflösenden Daten (z.B.: System IKONOS), Erstellung von Stadtplänen

- Geologie und Petrographie: visuelles Erkennen von Störungs- und Zerrüttungslinien, in semiariden/ariden Gebieten Differenzierung von verschiedenen Gesteinszonen, geologische Kartierung, Prospektion, Lagerstättenerschließung, Photogeologie (Schlussfolgerungen auf Gesteinstypen und tektonischen Aufbau)

- Natürliche Ressourcen: Management in vielen Bereichen

- Archäologie: Entdeckung und Kartierung historischer Stätten (z. B. mit Radarmethoden)

- Geomorphologie: visuelles Erkennen des morphologischen Formenschatzes

- Landwirtschaft: umfangreiche Programme zu Ertragsaussichten, Anbauarten-Differenzierung, Anbau-Kontrollen in Stichproben für die EU -Agrarförderung, Precision Farming

- Forstwirtschaft: Holzbewirtschaftung, Entwaldung, Waldschadensforschung, Waldbrände, Desertifikation, globaler saisonaler Vegetationswandel

- Global Change-Forschung: Urbanisierung, Zersiedelung und Veränderungen in der städtischen Umwelt

- Katastrophenmonitoring, -management: Waldbrände (Ausmaß der Zerstörung), Vulkanaktivität (Vorhersage, Risikoanalyse und Überwachung), Erdbeben (Risikoanalyse, Höhenänderung), Umweltverschmutzung (Öleinleitung auf den Weltmeeren), Überschwemmungen; Tsunamis, Gletscherläufe

- Umweltplanung: Erfassung der Oberflächenbedeckung, Umweltmonitoring, Wasser- und Feuchtgebietsmanagement

- Change Detection: Erkennung von Veränderungen, d. h. Beobachtung und Analyse von Veränderungen in der Landschaft im Laufe der Zeit

- Klimawandel und Untersuchung der Auswirkungen von Klimaveränderungen auf die Landschaft

- Bergbauaktivitäten: sowohl für den eigentlichen Bergbau als auch für die Sanierung einer Bergbauregion

- Küstenwesen, Ozeanographie: Überwachung von Gewässergüte, Aufspüren von Einleitungen, Beobachtung von Küstenveränderungen sowie (insb. mit Radarmethoden) Erfassung von Wellengang und Windgeschwindigkeit

- Hydrologie: Erfassen von Schneebedeckung und ihr Abschmelzen, Erfassung von Eingangsparametern für hydrologische Modelle (z.B. aktuelle Landbedeckung, Abschätzung der Evapotranspiration)

- Kryosphäre: Veränderungen von Schnee und Eis, z. B. Eisabbruch, Überwachung von Eisbergen und Navigation von Schiffen durch arktische oder antarktische Gewässer

- Klimaforschung, Wetterbeobachtung

- Sicherheitsüberwachung: Truppenbewegungen, militärische Anlagen

- Verkehrsmonitoring: Boden, Wasser, Luft

- Medien: Tourismusmarketing, Ausbildung, visuell ansprechender Hintergrund

Weitere Informationen (Auswahl):

- Satellitengestützte Fernerkundung im Dienst der Gesellschaft (Klaus Reiniger, DLR)

- Crafting Geoinformation - The art and science of Earth observation (GEO 2010)

- Erdbeobachtung in Zeiten der Globalisierung - Marktpotenziale der satellitengestützten Fernerkundung (BMWI, Monatsbericht 11/2013)

- Satellitendaten für den täglichen Einsatz - Raumfahrt im Bundesministerium für Verkehr, Bau und Stadtentwicklung (BMVBS 2010)

- Why observe the Earth? (CEOS, Earth Observation Handbook)

- 100 Earth Shattering Applications and Uses of Remote Sensing (GISGeography.com)

- Unternehmensspiegel zu Photogrammetrie, Fernerkundung, GPS u.w. (Business Geomatics)

- Tabellarische Auflistungen von FE-Einsatzgebieten, Anwendungsbereichen, Mess- und Auswerteverfahren, Methoden (Wikipedia)

- 100 Earth Shattering Remote Sensing Applications & Uses (GISGeography 2022)

- Remote Sensing (GISGeography 2022)

- Grundlagen der Fernerkundung (Kuechly, H.U. et al.; GFZ 2020)

- Copernicus für das Umweltmonitoring (Ehlert, I. und Schweitzer, C. Eds., 2018)

- Linklisten zur Fernerkundung